文章正文

文章正文

# 写作什么意思:深入解析写作的原理、算法及利弊

在数字化时代人工智能()逐渐成为各个领域的得力助手其中写作作为一种新兴的技术应用正在逐渐改变着人们对写作的认知。本文将深入探讨写作的含义、原理、算法及其利弊,帮助读者更好地理解这一技术。

## 一、写作是什么意思

写作即人工智能写作,是指通过人工智能技术,让计算机自动生成文章、故事、诗歌等各种文本的过程。写作系统常常采用自然语言应对(NLP)技术,通过大量的数据训练,使计算机可以理解、分析并生成人类语言。

## 二、写作原理

写作的原理主要基于自然语言解决(NLP)和机器学(ML)技术。以下是写作的几个关键原理:

### 1. 数据驱动

写作系统需要大量的文本数据作为训练素材。这些数据涵各种类型的文章、书、网页等。通过这些数据可学语言的规律、语法结构和表达办法。

### 2. 模型训练

写作系统采用深度学算法,如循环神经网络(RNN)、长短期记忆网络(LSTM)等对输入的文本数据实行训练。训练期间,会不断调整模型参数,使生成的文本更合人类语言惯。

### 3. 文本生成

在模型训练完成后能够依照输入的提示或关键词,生成相应的文本。这个过程称为文本生成。生成的文本可是一句话、一个落,甚至一整篇文章。

### 4. 自适应调整

写作系统具有自适应调整的能力。在生成文本的期间,会依照使用者的反馈和评价,不断优化生成的文本,使其更合客户的需求。

## 三、写作算法

以下是几种常见的写作算法:

### 1. 生成对抗网络(GAN)

生成对抗网络是一种无监学算法,由生成器和判别器组成。生成器负责生成文本判别器负责判断生成的文本是不是合人类语言惯。通过不断对抗,生成器能够生成越来越合请求的文本。

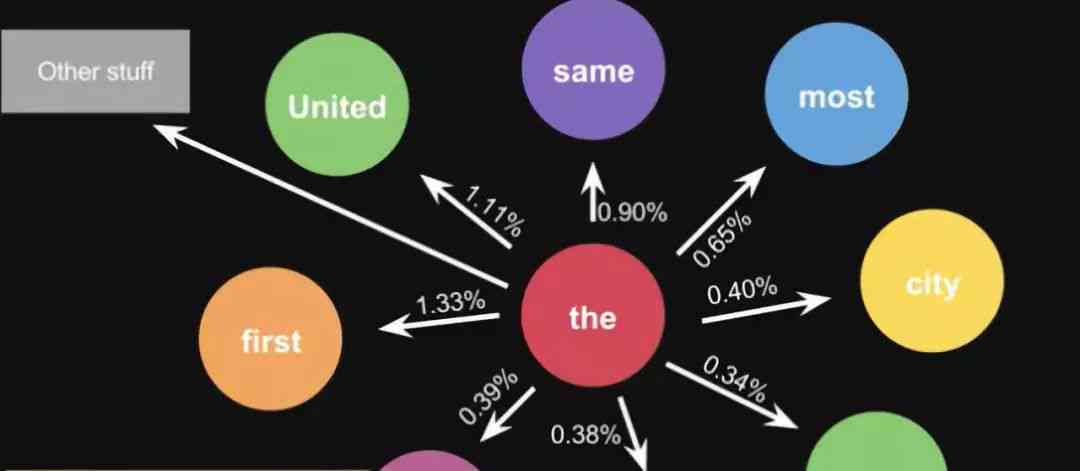

### 2. 循环神经网络(RNN)

循环神经网络是一种具有短期记忆能力的神经网络,适用于应对序列数据。在写作中,RNN能够用来预测下一个词语或句子。

### 3. 长短期记忆网络(LSTM)

长短期记忆网络是RNN的一种改进,具有长期记忆能力。在写作中,LSTM可更好地捕捉文本中的长距离依关系。

### 4. Transformer

Transformer是一种基于自关注力机制的神经网络模型,具有并行计算能力。在写作中,Transformer能够高效地生成文本,并增进生成优劣。

## 四、写作的利与弊

### 利

1. 提升写作效率:写作可迅速生成文章,节省人力物力。

2. 丰富写作内容:写作可生成多种类型的文本,为人们提供更多创意和灵感。

3. 突破语言限制:写作可帮助非母语人士升级写作水平,宽交流渠道。

4. 辅助学术研究:写作能够协助研究者分析大量文本数据,增强研究效率。

### 弊

1. 缺乏创新性:写作生成的文本往往基于现有数据,可能缺乏创新性。

2. 文本优劣不稳定:写作的文本品质受到训练数据和模型性能的作用可能存在语法错误或逻辑混乱。

3. 隐私和安全难题:写作可能涉及使用者隐私数据,如个人身份信息、浏览记录等,存在隐私泄露风险。

4. 对人类写作能力的影响:过度依写作可能引发人类写作能力的退化。

## 五、总结

写作作为一种新兴技术,具有巨大的发展潜力。它可帮助人们增强写作效率,丰富写作内容,突破语言限制,但同时也存在一定的局限性。为了充分发挥写作的优势,咱们需要不断优化算法,升级文本优劣,并关注隐私和安全难题。未来,随着技术的进步写作有望在更多领域发挥必不可少作用,为人类写作提供更多支持和帮助。