文章正文

文章正文

写作算法:揭秘原理、模型与写作应用

随着人工智能技术的不断发展写作已经成为了当今社会的一大热点。写作不仅涉及到了自然语言应对、深度学等前沿技术还广泛应用于新闻报道、广告文案、网络小说等多个领域。本文将从写作的原理、模型及写作应用三个方面为大家揭秘写作算法的奥秘。

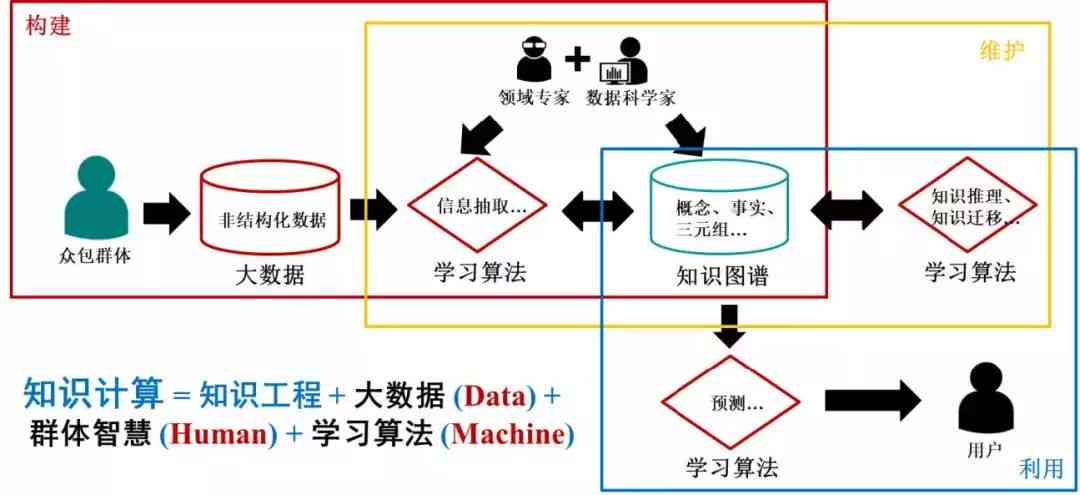

一、写作原理

写作的原理主要基于自然语言应对(NLP)技术。自然语言应对是计算机科学、人工智能和语言学领域的一个关键分支它旨在让计算机可以理解和生成人类自然语言。在写作中自然语言解决技术主要涉及以下几个方面:

1. 词向量表示:将词汇转化为计算机可理解的向量形式以便于计算和分析。常用的词向量表示方法有Word2Vec、GloVe等。

2. 语法分析:分析句子结构提取语法信息,如主谓宾、定状补等成分,以便于计算机理解句子含义。

3. 语义理解:通过词义消歧、实体识别等技术,使计算机能够理解句子中的具体含义。

4. 生成模型:依照输入的上下文信息,生成合语法、语义需求的句子。

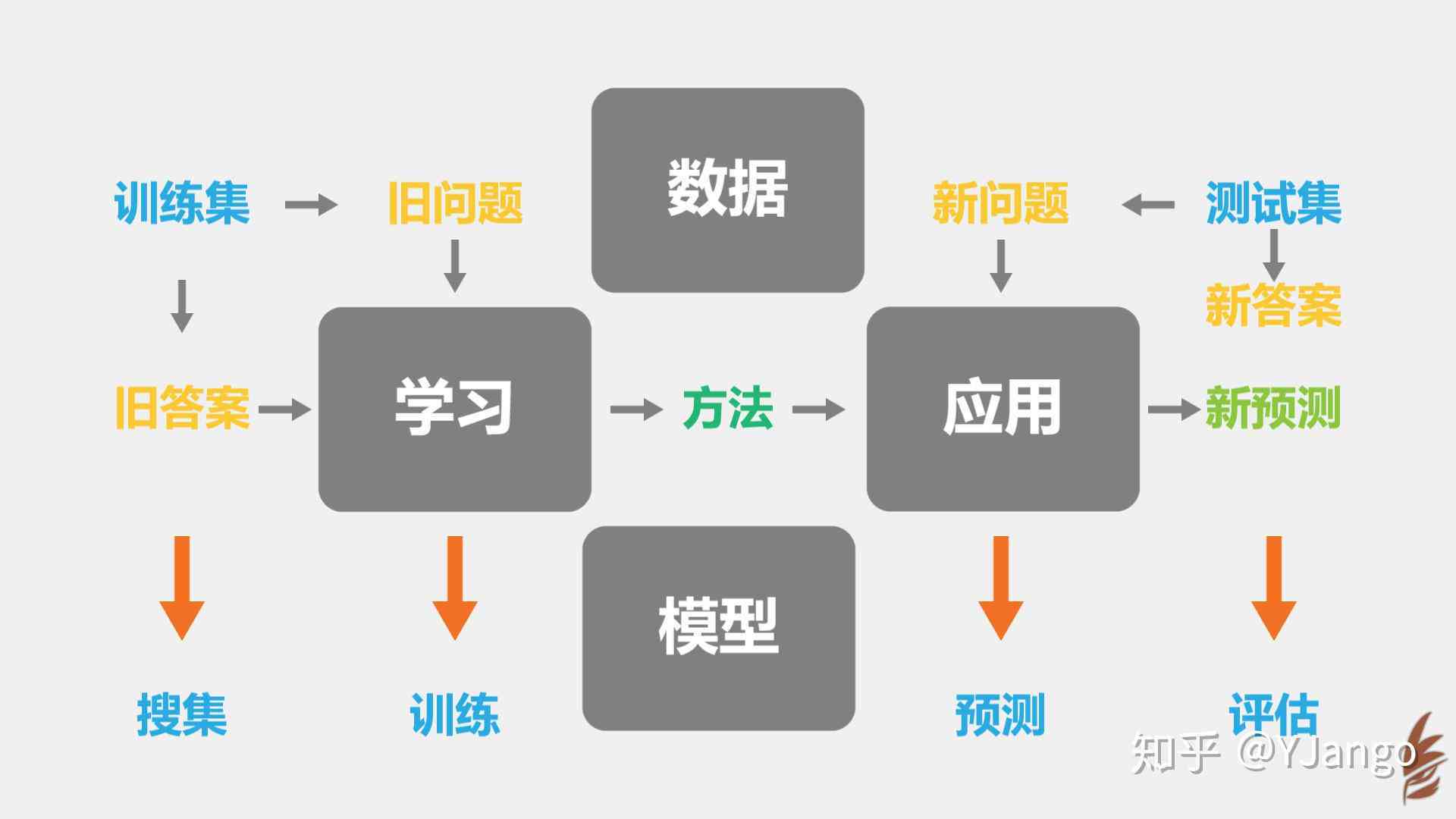

二、写作模型

目前写作模型主要分为以下几种:

1. 统计机器翻译模型:这类模型基于统计方法,将输入的文本映射为输出文本。典型的统计机器翻译模型有基于短语的模型和基于神经网络的模型。

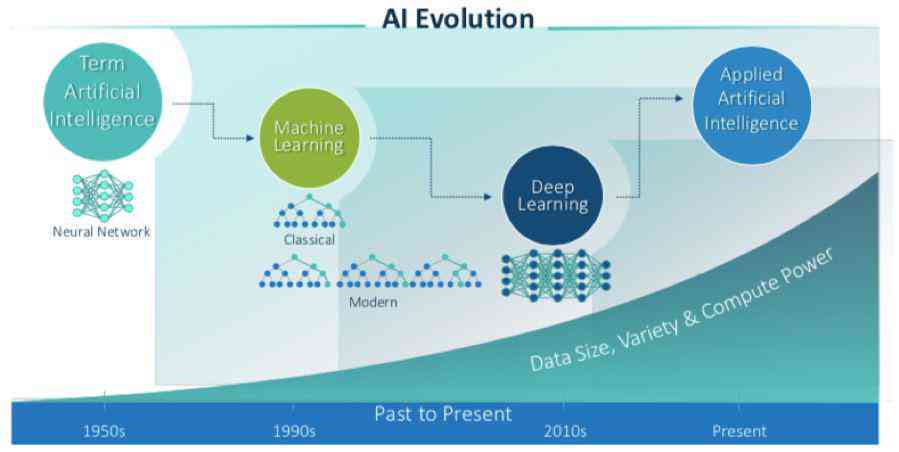

2. 神经网络模型:这类模型利用深度学技术,自动从大量文本中学写作规律。常见的神经网络模型有循环神经网络(RNN)、长短时记忆网络(LSTM)、生成式对抗网络(GAN)等。

3. 语言模型:这类模型专门用于生成自然语言文本,如N-gram模型、神经语言模型等。

以下简要介绍几种具有代表性的写作模型:

1. LSTM模型:长短时记忆网络(LSTM)是一种特殊的循环神经网络,它能够有效地应对长序列难题。在写作中,LSTM模型能够捕捉长距离的依关系,生成连贯的文本。

2. GPT模型:生成式对抗网络(GAN)是一种基于博弈理论的深度学模型。在写作中,GPT模型通过对抗训练,生成具有多样性的文本。

3. BERT模型:双向编码器表示(BERT)是一种基于Transformer的预训练语言模型。它通过双向预训练,能够更好地理解上下文信息,生成高优劣的文本。

三、写作应用

写作在各个领域都有广泛的应用,以下列举几个典型的例子:

1. 新闻报道:写作可自动生成新闻报道,如财经新闻、体育新闻等。此类办法可节省人力成本,提升新闻的时效性。

2. 广告文案:写作可依据产品特点、目标受众等因素,自动生成创意广告文案,提升广告效果。

3. 网络小说:写作可自动生成网络小说,为使用者提供多样化的阅读体验。

4. 教育辅导:写作可为学生提供作文批改、写作指导等服务,提升学生的写作能力。

5. 文学创作:写作可辅助作家实行文学创作,如自动生成诗歌、散文等。

写作算法为人类带来了多便利但在发展进展中也面临着若干挑战,如文本优劣、版权疑问等。随着技术的不断进步,咱们相信写作将在未来发挥更大的作用,为人类社会创造更多价值。