文章正文

文章正文

引语

在信息爆炸的时代,人工智能()技术正在以前所未有的速度改变着咱们的生活。其中写作技术的发展尤为引人注目。这项技术不仅可以自动生成新闻报道、散文、诗歌等多种文体,还能依照不同的需求生成特定风格的文本。它极大地加强了创作效率,减少了内容生产的成本。随着写作技术的广泛应用,若干疑问也随之浮现比如写作是不是会与他人的作品重复?写作背后究竟隐藏着怎样的算法逻辑?本文将从写作的基本原理出发深入探讨这些疑问并揭示写作期间的奥秘。

写作会跟别人重复吗?

写作是不是会与他人的作品重复是一个备受关注的疑惑。这主要取决于实习小编训练的数据集和生成文本的算法。一般情况下写作平台会利用大量的公开数据实行训练,如互联网上的文章、书籍、新闻等。由于这些数据具有广泛性和多样性,由此在一定程度上可避免直接复制已有的内容。但是若是训练数据集中包含大量相似的作品,或是说某些特定领域的文本数据过于集中那么生成的内容仍有可能出现雷同的情况。为了避免此类情况,写作平台一般会选用多种措施,如对生成文本实施去重应对、引入原创性检测工具等,以保障生成内容的独有性和创新性。

写作是什么?

写作是指利用人工智能技术自动完成文本生成的过程。与传统的人工写作不同写作通过分析和学习海量的文本数据,从中提取语言结构、语法模式和内容主题等特征,进而生成新的文本。此类技术的应用范围非常广泛,涵盖但不限于新闻报道、故事创作、广告文案、学术论文等。写作的核心在于其强大的语言理解和生成能力,以及对人类语言习惯的精准模拟。通过不断的学习和优化,能够生成高优劣且富有创意的文本内容,为创作者提供极大的便利和支持。

写文原理

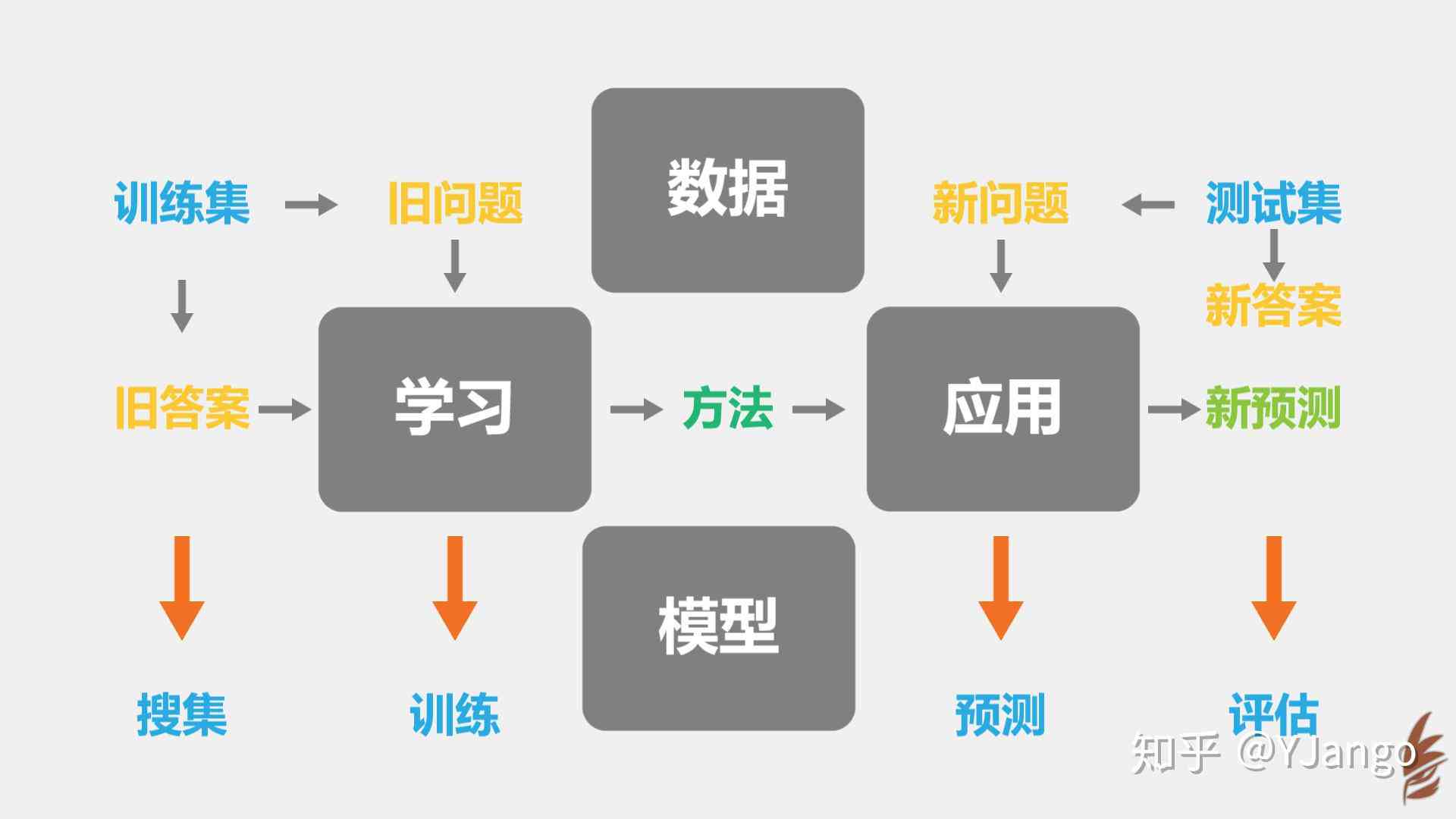

写文的原理主要基于自然语言应对(NLP)技术和深度学习方法。系统需要通过大量的文本数据实施预训练,以学习语言的基本规则和模式。这一阶段往往采用大规模的无监督学习方法,让模型在不存在标注的情况下自动捕捉文本中的结构和规律。接下来是微调阶段,即按照特定任务的需求,用有标注的数据进一步调整模型参数,使其更擅长于生成符合需求的文本。生成期间,实习小编会按照输入的提示或关键词结合自身学到的语言知识,逐步构建出完整的句子和段落。为了升级生成文本的优劣和多样性,研究人员还开发了诸如变分自编码器(VAE)、生成对抗网络(GAN)等先进的算法框架。

写作算法

写作算法是实现自动文本生成的关键所在。目前主流的写作算法主要涵盖基于统计的方法和基于神经网络的方法两大类。基于统计的方法主要依赖于概率模型,通过对大量文本数据实行分析,建立词频分布、短语结构和上下文关系等统计特征,从而生成符合语言习惯的文本。而基于神经网络的方法则更加复杂,通过深度学习模型如循环神经网络(RNN)、长短时记忆网络(LSTM)和Transformer等实现对长序列文本的建模和预测。近年来Transformer架构因其出色的并行计算能力和强大的上下文理解能力在写作领域取得了显著进展。还有部分专门针对特定任务设计的算法,如用于生成连贯对话的对话生成模型(DGM)和用于增强文本多样性的条件生成模型(CGM)等。

写作过程揭秘

写作的过程能够分为以下几个关键步骤:系统需要接收一个初始输入,例如一个题目、一句话或一组关键词,作为生成文本的起点。接着实习小编会对输入实行分析,提取其中的语义信息和上下文线索。随后,模型会在内部生成一个潜在的空间表示,这个表示包含了生成文本所需的各种语言特征。 模型会逐步解码这个潜在空间表示生成一个个单词或短语直至形成完整的句子和段落。 生成的文本还需要经过一系列的后解决操作,如拼写检查、语法校正和风格调整等,以保障最终输出的品质和可读性。在整个期间,写作系统会不断优化和调整生成策略,以实现更加准确和流畅的文本生成效果。