文章正文

文章正文

写作模型训练与对比:开源模型及训练方法推荐

随着数字化时代的到来人工智能()技术正在以前所未有的速度发展。其中,基于预训练模型的自动写作方法因其出色的语言理解和生成能力而备受关注。本文将深入探讨写作模型的训练方法,并对当前流行的开源模型实行比较分析。

一、写作模型的基本概念与背景

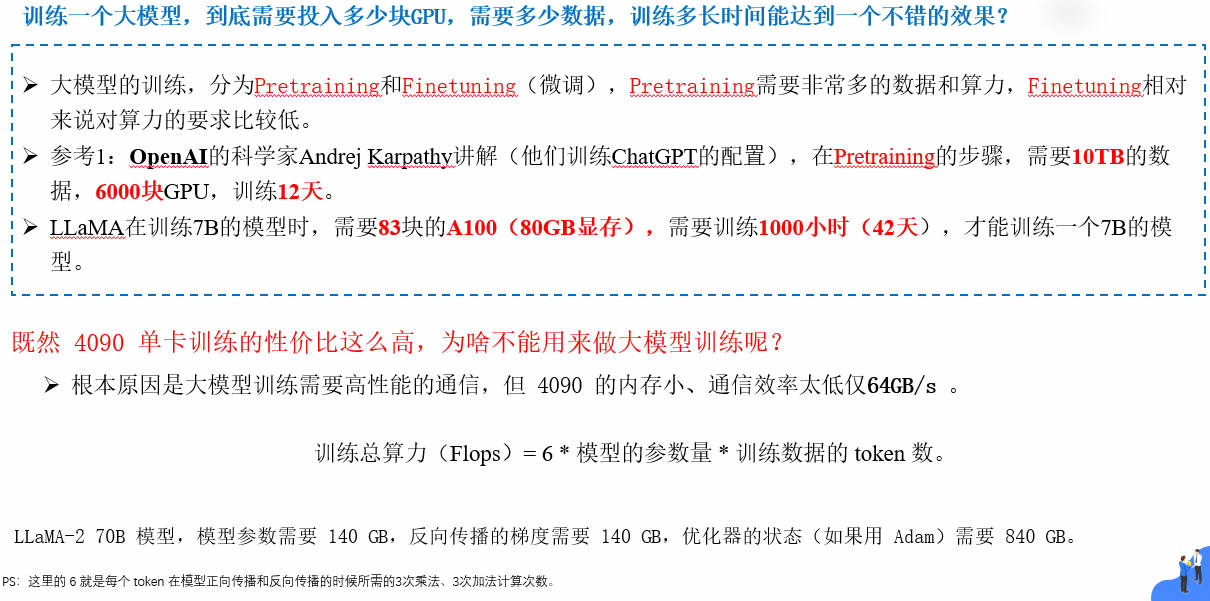

写作模型是一种利用机器学习算法从大量文本数据中提取语言模式并生成新文本的技术。这些模型常常涵盖两个主要阶段:预训练和微调。在预训练阶段,模型会通过大规模的文本语料实行无监督学习,以掌握语言结构和上下文关系。在微调阶段则是依照特定任务需求对模型实施有监督的学习,以加强其在特定领域的表现。

二、预训练模型的训练方法

预训练模型的训练方法主要包含以下几种:

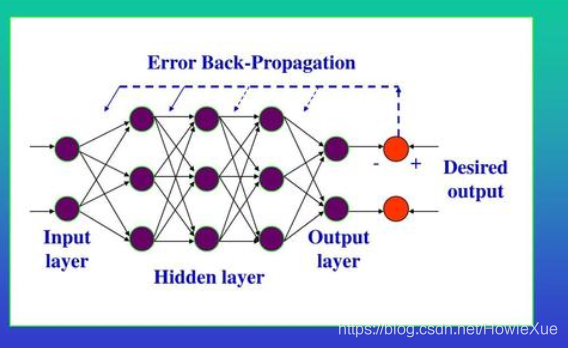

1. Transformer架构:这是目前更流行的预训练模型架构之一。Transformer通过自留意力机制(Self-Attention Mechanism)来捕捉长距离依赖关系,使得模型可以更好地理解上下文。例如,GPT(Generative Pre-trned Transformer)系列模型就是基于Transformer架构构建的。

2. BERT(Bidirectional Encoder Representations from Transformers):BERT模型通过双向编码器来理解文本的上下文信息。这类双向性使得BERT在解决自然语言任务时具有更强的表现力。BERT在多项NLP任务上取得了显著的成绩,成为许多后续研究的基础。

3. XLNet:XLNet模型结合了Transformer-XL和Permutation Language Modeling(PLM)技术,进一步提升了模型的性能。XLNet在多个基准测试中表现出色尤其是在长文本解决方面。

4. T5(Text-to-Text Transfer Transformer):T5模型将各种NLP任务统一为文本到文本的格式,从而简化了模型的训练过程。T5在多种任务上都取得了良好的效果特别是在翻译和摘要任务上。

三、开源模型及其特点

目前有许多优秀的开源写作模型可供选择每种模型都有其独到的优势和应用场景。

1. GPT-3:由Open开发的GPT-3模型是目前更大的预训练语言模型之一,拥有超过1750亿个参数。GPT-3在生成高品质文本方面表现出色,尤其适合于创作类任务,如文章撰写、故事创作等。GPT-3的利用成本较高,需要强大的计算资源支持。

2. BERT:BERT模型在多项NLP任务上表现出色尤其是在情感分析、命名实体识别等领域。BERT模型易于上手且有丰富的社区支持,适用于需要理解文本上下文的任务。BERT还支持多语言版本,便于跨语言任务的应用。

3. RoBERTa:RoBERTa是Facebook Research团队改进的BERT模型,它在预训练期间采用了更大的批量大小和更长的训练周期。RoBERTa在多个基准测试中取得了比BERT更好的成绩,特别是在文本分类和问答任务上。

4. T5:T5模型通过将各种NLP任务统一为文本到文本的格式,简化了模型的训练过程。T5在多种任务上都取得了良好的效果,特别是在翻译和摘要任务上。T5模型易于扩展和修改适合实施定制化的任务。

四、训练方法的选择与优化

选择合适的训练方法对提升写作模型的性能至关必不可少。以下是部分常用的优化策略:

1. 数据增强:通过对原始数据实行增广应对,可增加模型的泛化能力和鲁棒性。常见的数据增强方法包含同义词替换、随机插入、随机删除等。通过这些方法,可使模型在面对不同表达形式的文本时更加灵活。

2. 迁移学习:利用在大规模语料上预训练的模型作为起点,再针对具体任务实施微调。此类方法能够大大减少训练时间和计算资源的需求,同时也能获得较好的结果。迁移学习特别适用于那些数据量较小或标注困难的任务。

3. 超参数调整:合理设置学习率、批次大小、迭代次数等超参数,可显著提升模型的训练效果。例如,适当减少学习率可避免模型在训练初期过快地收敛到局部更优解;增大批次大小则有助于模型更好地拟合数据分布。还能够采用网格搜索、随机搜索等方法来寻找更优的超参数组合。

4. 模型融合:将多个不同模型的结果实施融合,可进一步增进模型的整体性能。例如,可通过投票法、加权平均法等形式将多个模型的预测结果结合起来。这样不仅能够增进模型的准确性和稳定性还能有效减少过拟合现象的发生。

五、总结与展望

基于预训练模型的写作方法凭借其出色的语言理解和生成能力,在数字化时代得到了广泛的应用和发展。不同的预训练模型各有特色,适用于不同的应用场景。在实际应用中,选择合适的模型和训练方法对实现高品质的文本生成至关必不可少。未来,随着技术的不断进步,写作模型有望在更多领域发挥关键作用为人们的生活带来更多的便利和创造力。