文章正文

文章正文

引语

在信息爆炸的时代写作技术正逐渐成为内容生产的必不可少工具。从新闻报道到小说创作从商业文案到学术论文写作的应用场景越来越广泛。随着写作技术的普及人们也逐渐开始关注其背后的机制和局限性。本文将深入探讨写作的原理涵盖怎么样避免重复以及其背后的算法机制。通过揭示写作的奥秘咱们不仅能更好地理解这一技术的发展趋势还能更有效地利用它来提升工作效率、创造更多价值。

写作会跟别人重复吗?

写作是不是会与他人重复主要取决于其训练数据集的多样性和算法的设计。写作系统常常基于大量的文本数据实行训练,这些数据来自不同的来源,如新闻、书籍、网站等。若是训练数据集足够丰富和多样,那么生成的内容就不太可能与其他人的作品雷同。倘使训练数据集中存在大量相似的内容,或实习小编的参数设置不当,那么生成的结果就可能与其他作品出现相似之处。 为了减少重复的可能性,需要不断优化训练数据集的品质和多样性,并改进实习小编的参数配置。

写作是什么?

写作是一种基于人工智能技术自动生成文本内容的方法。具体而言,它通过机器学习算法对大量文本数据实施分析和学习,从而掌握语言结构、语法规范以及词汇搭配等知识。当使用者提出写作需求时,写作系统可以按照输入的关键词或主题,快速生成符合请求的高品质文本。这类技术不仅极大地增强了内容生产的效率,还能够为使用者提供个性化定制的服务。例如,在商业领域可针对不同客户群体撰写个性化的营销文案;在教育领域,能够按照学生的兴趣和能力推荐适合的学习材料。

写文原理

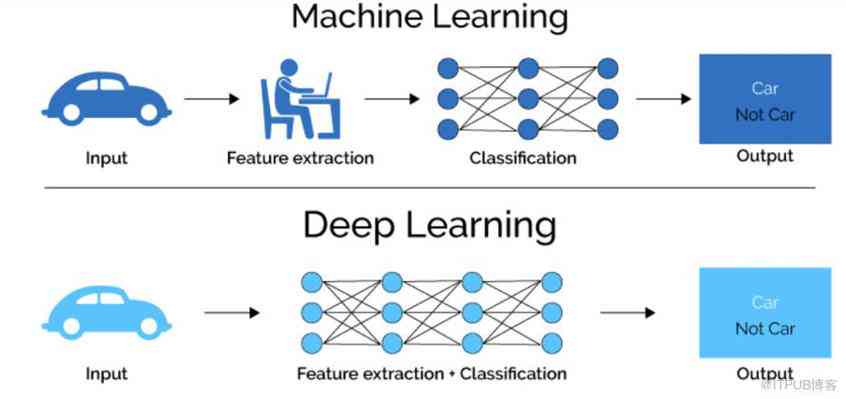

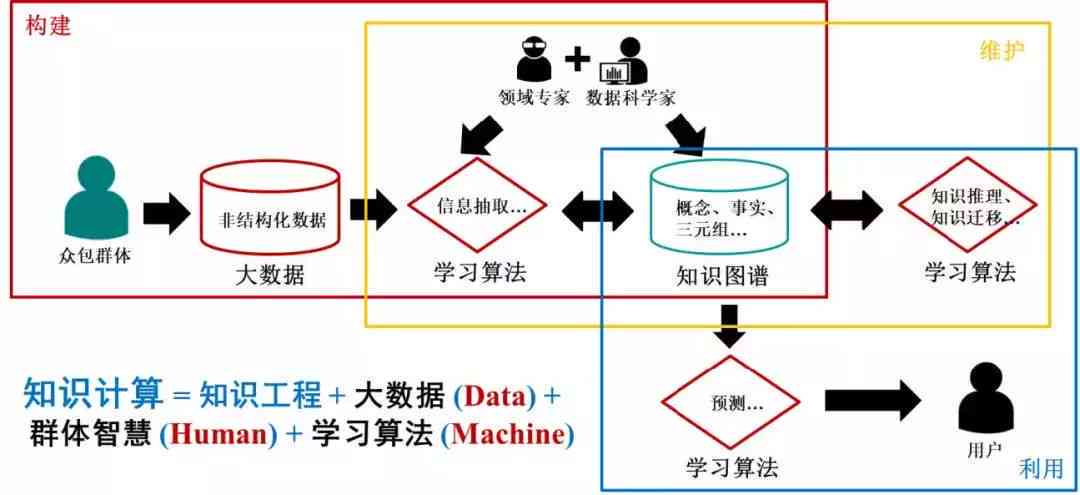

写文的核心在于深度学习和自然语言解决(NLP)技术。需要通过大规模的文本数据集实行预训练,以获取对语言的理解和表达能力。这一过程涉及神经网络模型,如Transformer架构它通过自关注力机制捕捉文本中的长距离依赖关系。预训练完成后,还需要经过微调阶段以便适应特定领域的任务需求。例如,在新闻写作中,可能需要学习怎么样快速准确地总结要点;而在小说创作中,则需要掌握情节构建和人物塑造的能力。微调期间,会依据标注数据调整模型参数,从而提升生成文本的优劣和相关性。

写作算法

写作算法主要分为两类:生成式模型和检索式模型。生成式模型采用深度学习方法,如循环神经网络(RNN)、长短时记忆网络(LSTM)和Transformer等,通过对大量文本数据实行训练,学习语言的统计规律。当客户提出写作需求时,生成式模型会按照输入的信息生成新的文本。而检索式模型则通过从已有的文档库中检索最相关的片段并重新组合成新文档。虽然检索式模型在一定程度上能避免重复,但其灵活性和创新性相对较弱。相比之下生成式模型虽然更容易出现重复,但其在创造性方面具有明显优势。 许多先进的写作系统会结合这两种方法,以充分发挥各自的优势。

总结

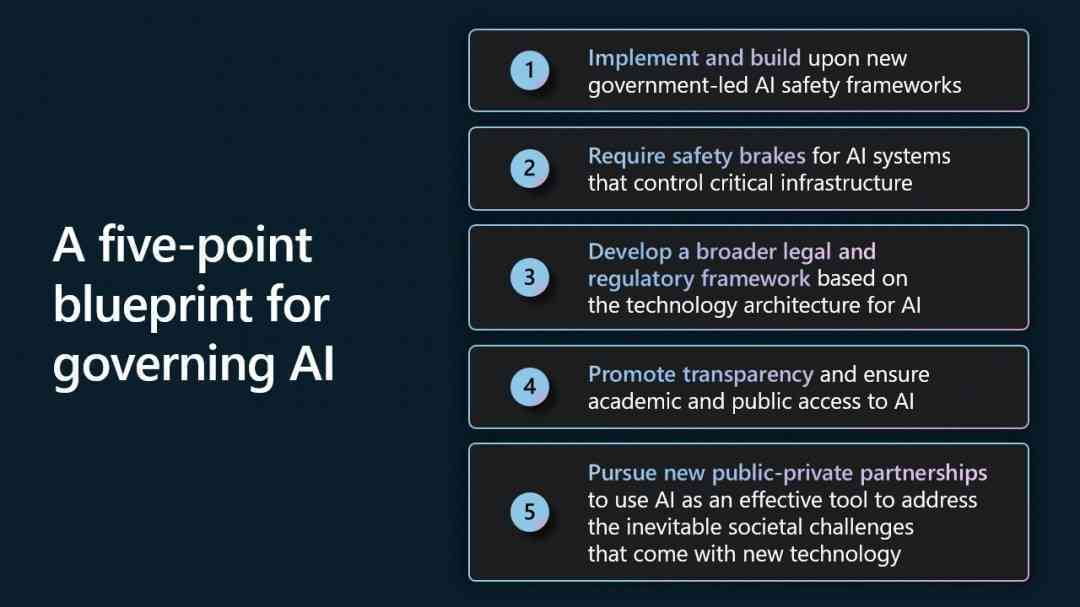

写作作为一种新兴的技术手段,正在改变着我们的工作形式和生活形式。通过不断优化训练数据集、改进算法设计以及融合多种技术手段,写作系统能够更好地满足使用者的需求,实现高效、高品质的内容生产。未来,随着技术的进一步发展,写作将在更多领域展现出更大的潜力和应用前景。