文章正文

文章正文

在当今数据驱动的时代决策树作为一种简单直观且强大的机器学算法被广泛应用于分类和回归任务中。它通过树状结构将数据集分割成多个子集每个子集都对应于数据的一个特定属性从而实现预测目标。本文将详细介绍生成决策树的两个过程并通过例题解析以及算法核心环节的深入探讨帮助读者更好地理应对策树的构建原理与应用。

引言

决策树算法因其易理解、易实现的特点,在机器学领域占据着关键地位。它可以依据数据特征自动构建出分类或回归模型,为实际疑惑提供解决方案。本文将首先通过一个生成决策树的例题引出决策树生成期间的关键概念。随后,咱们将深入解析决策树生成的算法核心环节,以便读者可以更全面地掌握这一算法。

一、生成决策树例题

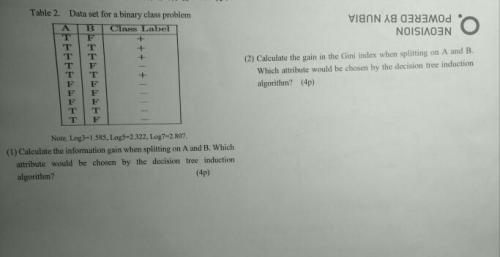

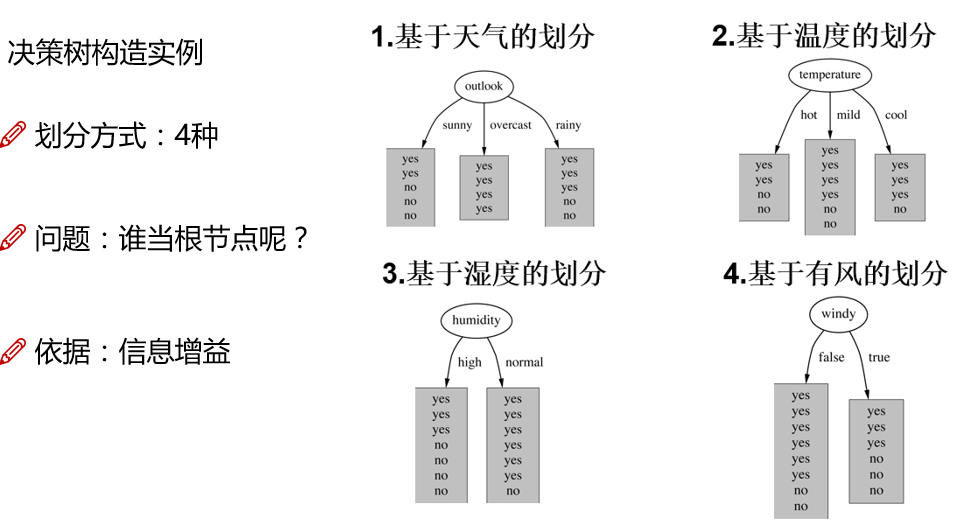

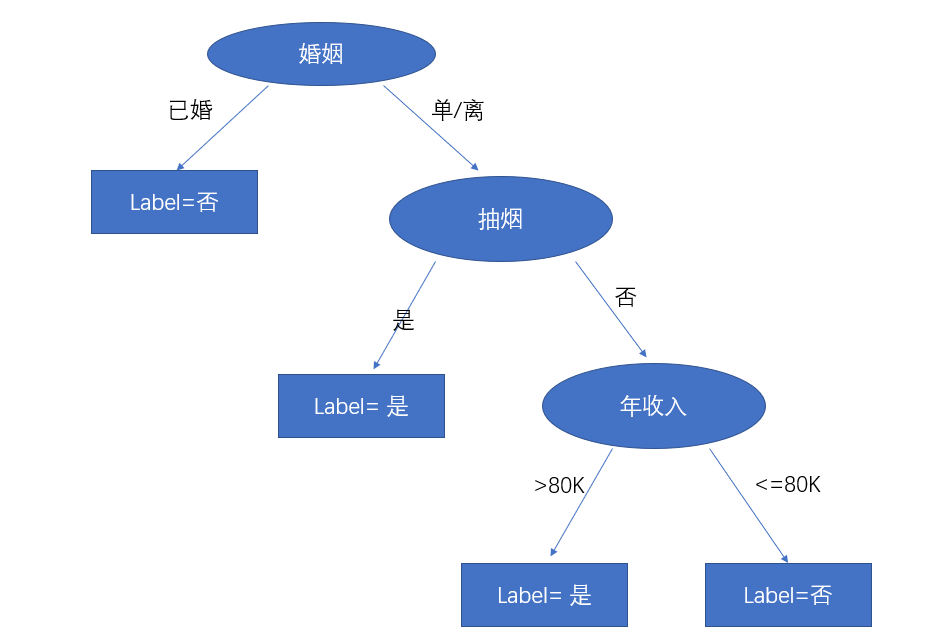

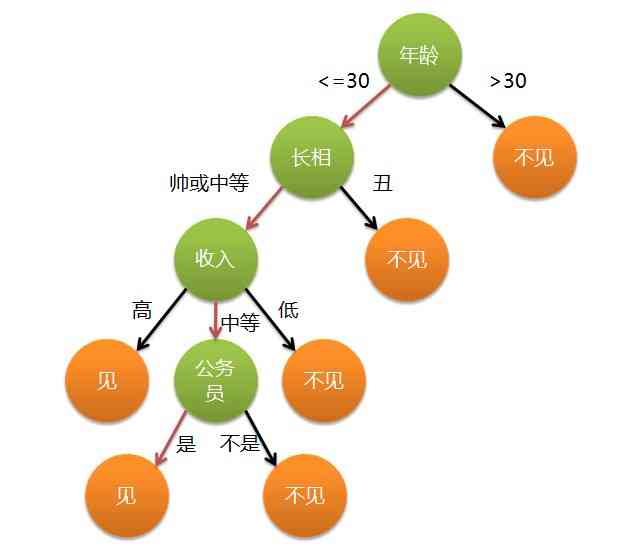

决策树的生成算法主要有两种:ID3算法和C4.5算法。下面咱们通过一个简单的例题来展示决策树的生成过程。

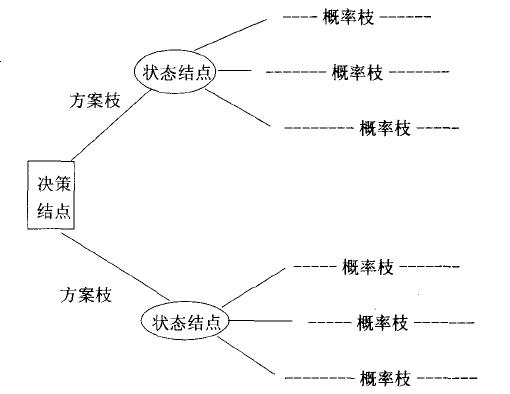

例题:假设有一个数据集,包含四个属性:性别、年龄、职业和收入,以及一个目标属性:是不是购买产品。咱们需要按照这些属性生成一棵决策树,以预测新数据是不是购买产品。

二、决策树生成的两个阶

1. 特征选择

特征选择是生成决策树的之一步。在这一阶,算法需要从数据集中选择一个最有作用力的特征作为根节点。常常,我们利用信息增益、增益率或基尼指数等指标来评估特征的作用力。以信息增益为例,它量的是选择某个特征后,数据集的不确定性减少的程度。

2. 树的构建

在确定了根节点后,算法将数据集遵循根节点的特征值分割成多个子集,并对每个子集重复特征选择和树的构建过程,直到满足以下条件之一:所有子集都属于同一类别,或不存在特征可继续分割,或达到预设的树深度。

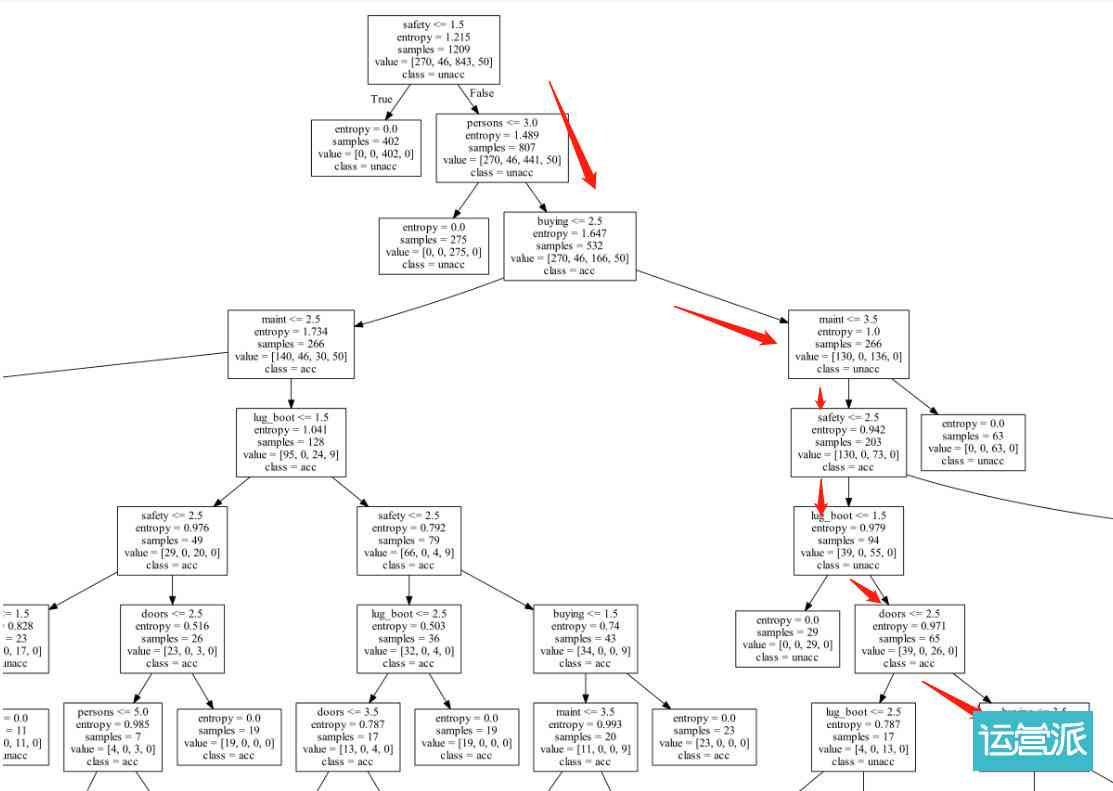

三、自动生成决策树

自动生成决策树的关键在于算法的递归调用。在每一步特征选择和树的构建期间,算法都会自动选择更优特征并构建子树。这个过程能够通过递归函数实现,直到满足上述结条件。

在自动生成决策树的进展中,我们需要考虑以下几个难题:

1. 怎样选择更优特征?

2. 怎么样应对缺失值?

3. 怎么样避免过拟合?

四、决策树生成的核心环节

1. 特征选择

特征选择是决策树生成的核心环节之一。选择合适的特征能够显著提升树的预测精度。常用的特征选择指标有信息增益、增益率和基尼指数等。

信息增益:选择具有更大信息增益的特征作为节点,信息增益越大,说明该特征对分类结果的影响越大。

增益率:增益率的计算考虑了特征选择引发的分支不均匀性常常比信息增益更稳定。

基尼指数:基尼指数越小,说明数据集的纯度越高,分类效果越好。

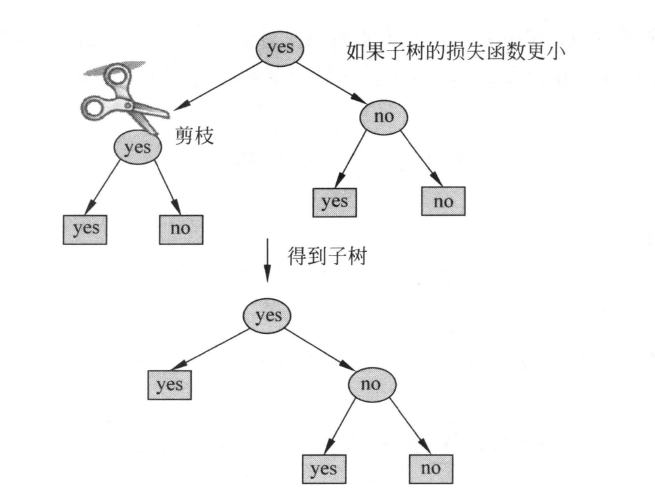

2. 树的剪枝

为了避免过拟合,决策树多数情况下需要实行剪枝。剪枝分为预剪枝和后剪枝两种策略。

预剪枝:在构建树的进展中,提前设定停止条件,如树深度、节点最小样本数等。

后剪枝:在树完全生长后,通过剪枝算法删除不要紧的分支,以减少过拟合。

3. 决策树可视化

为了更好地理解决策树的结构和预测过程我们可将决策树可视化。常用的可视化工具涵Graphviz、Matplotlib等。

总结

生成决策树是机器学中的一项基本任务,通过理解其生成过程和算法核心环节,我们可更好地应用决策树解决实际疑问。本文通过例题解析和算法核心环节的探讨,为读者提供了关于决策树生成的全面认识。在未来的学和实践中,读者能够不断深化对决策树的理解,并将其应用于更广泛的领域。