文章正文

文章正文

引言

近年来随着人工智能技术的迅速发展写作成为了一个备受关注的话题。写作指的是利用计算机程序自动生成文本内容,其应用范围广泛从新闻报道、文学创作到商业文案,几乎涵盖了所有需要文字创作的领域。随着写作能力的不断提升,人们对其潜在风险和伦理疑问也产生了诸多担忧。一方面写作可以极大地增强写作效率和品质,节省人力成本;另一方面,它也可能造成版权争议、信息真实性难以保障以及人类创造力被削弱等疑问。 本文将深入探讨写作的意义、原理与算法旨在帮助读者全面熟悉这一新兴技术,并对其未来的发展趋势做出思考。

写作的意义

写作的意义在于其可以显著提升写作效率和品质,尤其是在解决大量重复性任务时。例如,在新闻行业,写作可快速生成大量的新闻稿件,尤其在体育赛事、财经报道等标准化程度较高的领域。这不仅能够大幅减低新闻生产成本,还能够确信新闻内容的时效性和准确性。写作还可用于文学创作,为作家提供灵感和素材,甚至创造出具有特别风格的作品。这也引发了部分伦理和法律疑惑比如版权归属、作品原创性等。 怎样平衡写作带来的便利与潜在风险,是当前亟待解决的疑惑。

写作的原理

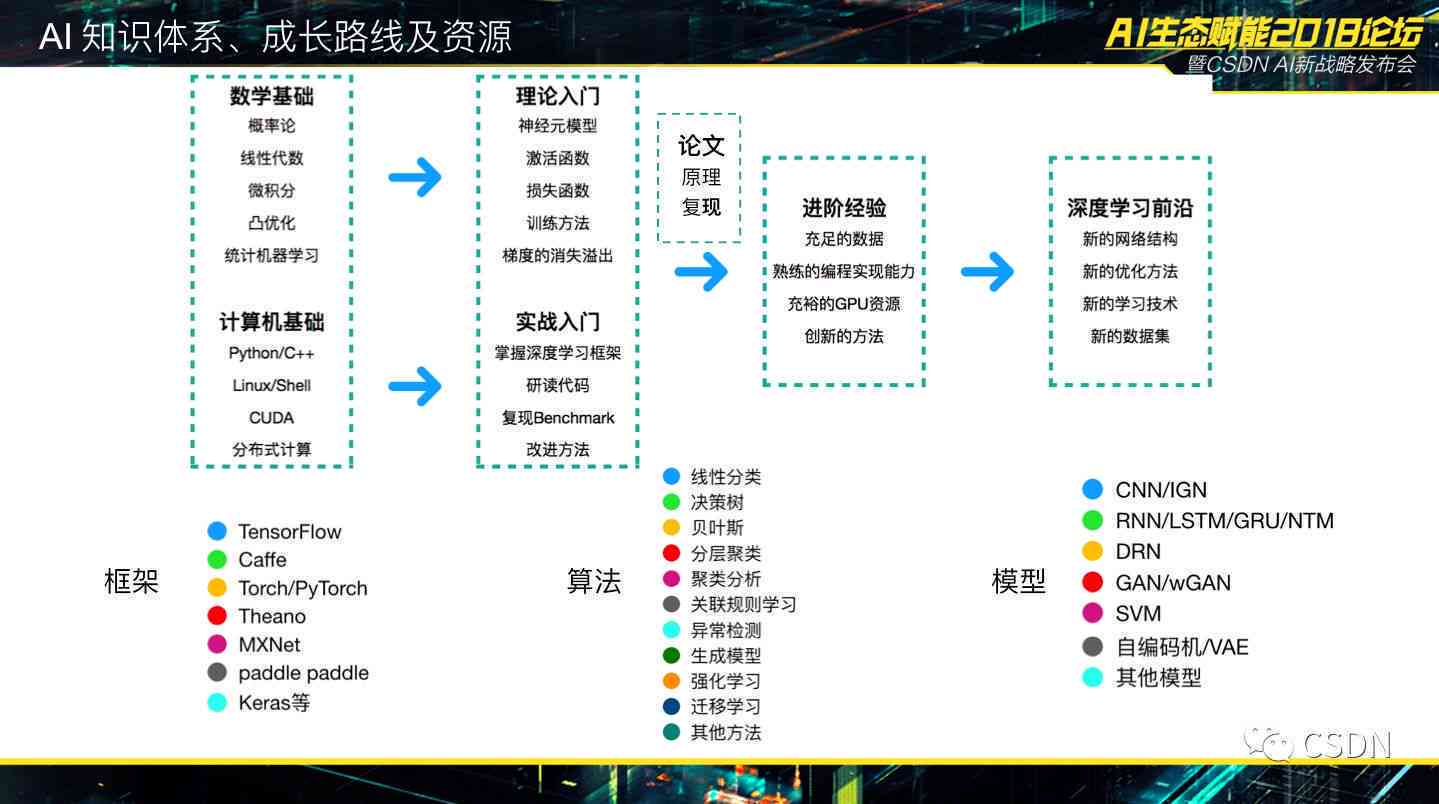

写作的核心原理是自然语言解决(NLP)和机器学习(ML)。NLP技术让机器能够理解人类语言的语法结构和语义含义。通过分析大量的文本数据,系统能够学习到词汇、短语和句子之间的关系,从而具备理解和生成自然语言的能力。机器学习算法使系统能够不断优化其写作模型。通过对输入数据的学习,系统能够逐步调整其参数,以生成更加准确和流畅的文本。这类学习过程常常是通过监督学习、无监督学习和强化学习等多种方法实现的。其中,监督学习是指采用带有标签的数据集实施训练,使系统能够识别并模仿特定的写作风格;无监督学习则是通过挖掘未标注数据中的模式来生成文本;而强化学习则是在模拟环境中让系统通过不断的试错来优化其写作策略。

写作的算法

目前写作中常用的算法主要包含基于规则的方法、统计方法和深度学习方法。基于规则的方法主要依赖于预设的语言规则和模板通过编程实现特定的文本生成逻辑。这类方法的优点在于可控性强,但缺点是灵活性较差,难以应对复杂多变的写作需求。统计方法则是通过分析大规模文本数据,提取出语言特征和模式,然后依据这些特征生成新的文本。此类方法的优点是能够解决较为复杂的写作任务,但其效果很大程度上取决于训练数据的品质和数量。近年来深度学习方法逐渐成为主流。基于神经网络的深度学习算法能够自动学习和提取文本中的高级特征,从而生成更加自然和连贯的文本。其中循环神经网络(RNN)、长短期记忆网络(LSTM)和Transformer模型是最为常见的几种架构。这些模型能够捕捉文本中的长期依赖关系,从而生成高品质的文本内容。深度学习方法也存在若干挑战如计算资源消耗大、过拟合疑问以及对训练数据的须要高等。 怎样进一步优化这些算法,使其在实际应用中更加高效和可靠,是未来研究的重点方向之一。

总结

写作作为一种新兴的技术手段既带来了前所未有的便利也引发了诸多伦理和法律疑惑。通过深入理解写作的意义、原理与算法,咱们不仅能够更好地认识这一技术的本质,还能为其健康发展提出建设性的建议。未来,随着技术的不断进步和完善,写作有望在更多领域发挥要紧作用,同时也需要咱们共同关注其可能带来的负面作用,以保障其健康发展,造福社会。